O retorno do "Small Data" e a obsessão pela qualidade dos dados

Nos últimos dez anos, o mundo corporativo viveu o mantra do "quanto mais, melhor". O termo Big Data dominou as reuniões de diretoria, levando empresas a acumular terabytes de informações em lagos de dados (Data Lakes). A promessa era simples: se coletarmos tudo, as respostas surgirão magicamente.

Chegamos em 2026 e a realidade se impôs. Muitas empresas descobriram que, em vez de um "lago de dados" cristalino, construíram um "pântano de dados" — turvo, desorganizado e difícil de navegar.

Com a ascensão das Inteligências Artificiais Generativas nas empresas, esse problema ficou evidente. Quando você alimenta uma IA com dados ruins, ela não apenas erra; ela "alucina" com confiança. É o velho princípio da computação elevado à máxima potência: Garbage In, Garbage Out (Lixo entra, Lixo sai).

É por isso que a tendência agora é o caminho inverso. Bem-vindo à era do Small Data e da Qualidade Absoluta.

O que é "Small Data" (e por que ele vale ouro)

Não se deixe enganar pelo nome. Small Data não significa "poucos dados" ou amostras insignificantes.

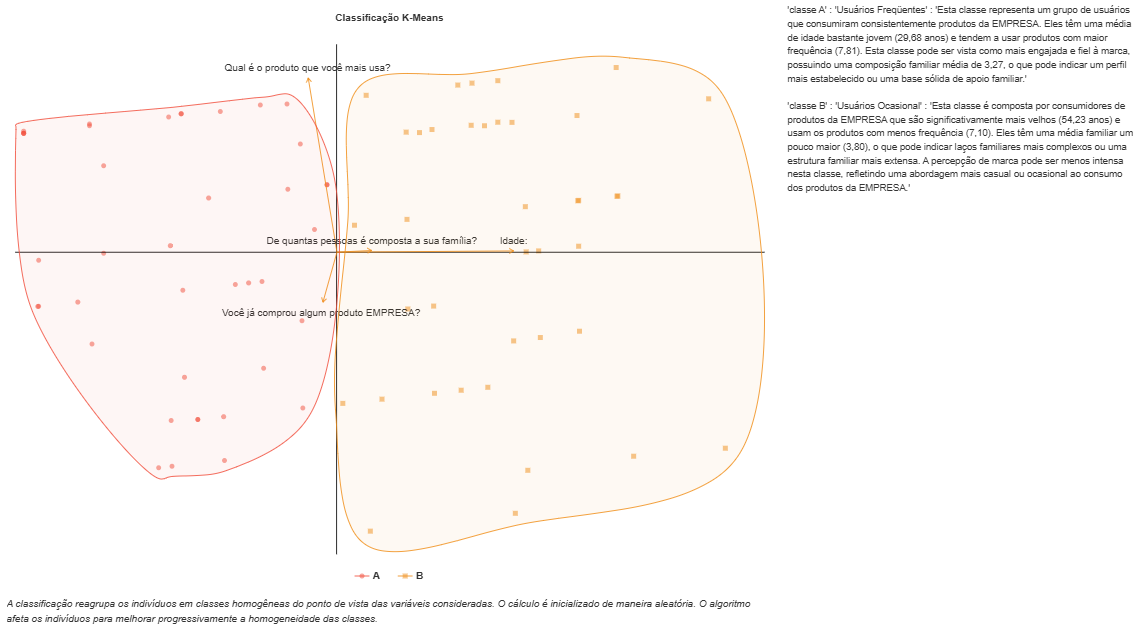

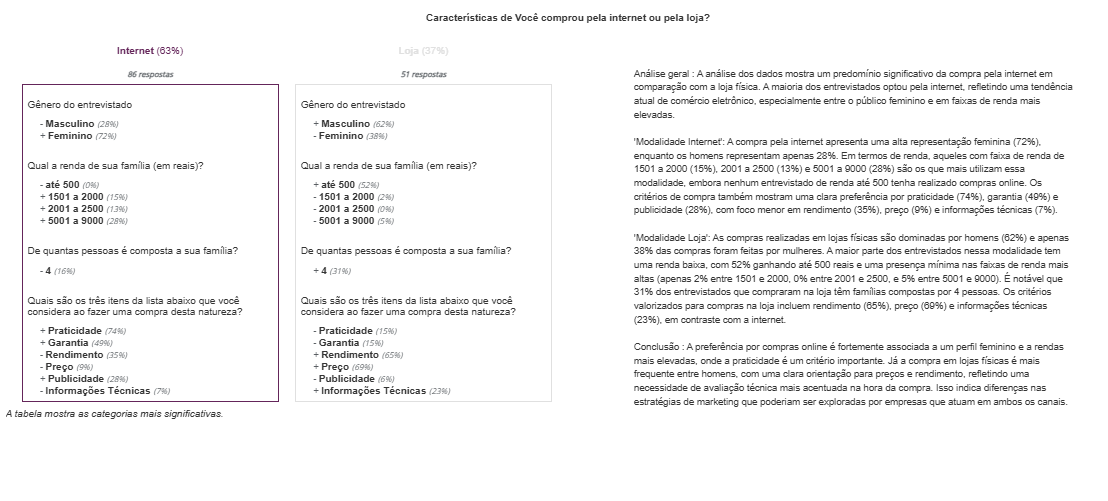

Enquanto o Big Data busca correlações em massas gigantescas de informação (ex: "quem compra fraldas também compra cerveja"), o Small Data foca na causalidade, na emoção e no "porquê". São dados acessíveis, compreensíveis por humanos e acionáveis.

Geralmente, o Small Data vem de interações diretas: uma survey bem estruturada, um feedback de cliente no pós-venda, uma entrevista em profundidade. É o dado que conecta os pontos e conta a história que os algoritmos cegos não conseguem ver.

Para quem trabalha com pesquisa de mercado e Customer Experience (CX), o Small Data é a chave para a personalização. Mas ele tem uma regra de ouro: ele precisa ser limpo.

O Perigo das Bases Sujas nas Surveys

A maior ameaça à credibilidade de um departamento de pesquisa hoje não é a falta de software, mas a falta de higiene nos dados. Em um mundo onde todos são bombardeados por formulários, a qualidade das respostas caiu.

Se a sua base de dados contiver "ruído", suas decisões estratégicas estarão baseadas em ilusões. Os principais vilões que identificamos nas análises via Sphinx são:

- Os "Speeders": Respondentes que preenchem uma pesquisa de 10 minutos em 30 segundos apenas para ganhar um brinde ou incentivo.

- Os "Straight-liners": Pessoas que marcam a mesma opção (ex: nota 7 ou a primeira alternativa) em todas as perguntas de uma grade, sem ler o enunciado.

- Inconsistência Lógica: O respondente que diz ter 18 anos na primeira pergunta e afirma ser aposentado há 10 anos na última.

Se você jogar esses dados sujos em um dashboard, você terá gráficos bonitos, mas mentirosos.

A Solução: Higiene de Dados como Processo, não Evento

Como garantir que o seu Small Data seja poderoso? A resposta está na etapa que muitos analistas ignoram por acharem "chata": o processamento e a consistência dos dados.

No ecossistema Sphinx, defendemos que a qualidade deve ser garantida em três tempos:

1 - No Design (Antes)

A qualidade começa na pergunta. Questionários longos, repetitivos ou com linguagem confusa geram fadiga e, consequentemente, dados ruins. O uso de lógicas de salto e a adaptação do questionário ao dispositivo (Mobile First) são obrigatórios para respeitar o tempo do respondente.

2 - Na Coleta (Durante)

O software de pesquisa precisa atuar como um "goleiro". Configurações de validação de campo (ex: não aceitar texto em campo numérico) e controles de cota em tempo real impedem que o lixo entre na base.

3 - Na Limpeza (Depois)

É aqui que separamos os amadores dos profissionais. Antes de gerar qualquer gráfico, é vital aplicar filtros de qualidade. Ferramentas analíticas modernas permitem isolar automaticamente os outliers (pontos fora da curva) e identificar padrões de preenchimento sem reflexão. No Sphinx iQ3, por exemplo, é possível criar scripts de "saneamento" que sinalizam ou excluem respostas suspeitas baseadas no tempo de preenchimento ou na variância das respostas.

Conclusão: Menos Volume, Mais Valor

Em 2026, o diferencial competitivo não é quem tem o maior servidor de dados, mas quem tem os dados mais confiáveis.

Um dataset de 500 respostas limpas, verificadas e com comentários qualitativos ricos vale mais do que uma base de 50.000 linhas repleta de bots e respostas aleatórias.

Para os profissionais de Consumer Insights e Dados, o recado é claro: pare de ficar obcecado pelo tamanho da amostra e comece a obcecar pela integridade dela.

Veja Também: